Паника из‑за AI: как сохранять спокойствие

Дата: 26 июня 2023

Популярность искусственного интеллекта так выросла, что некоторых специалистов охватила паника из-за AI. Мы активно изучаем эту тему и частично перевели статью от Center for Data Innovation о том, стоит ли на самом деле паниковать — затронули ту часть, что касается непосредственно AI.

Поделились своим мнением о проблеме

Иван Дудин

руководитель IT-проектов CRM-group

Инна Чикина

web-designer студии Process

Никита Швецов

CRM-маркетолог CRM-group

Александр Волков

CRM-маркетолог CRM-group

Когда читаешь исследования и статьи про AI, кажется, что впереди только худшее: кризис на рынке труда, снижение интеллектуальных способностей человека, полная потеря приватности и вообще конец света.

С приходом генеративного AI (Chat GPT, Midjourney и других) страх только усиливается: теперь инструмент способен создавать сложные тексты, картинки и видео с минимальным участием человека.

Однако, технологическая паника — совсем не новое явление. Возьмём, к примеру, музыкальную индустрию: когда появились студии звукозаписи, все боялись, что это убьёт концертную индустрию, а с появлением радио, многие говорили о конце звукозаписывающих компаний. Однако ни один из этих страхов не претворился в жизнь.

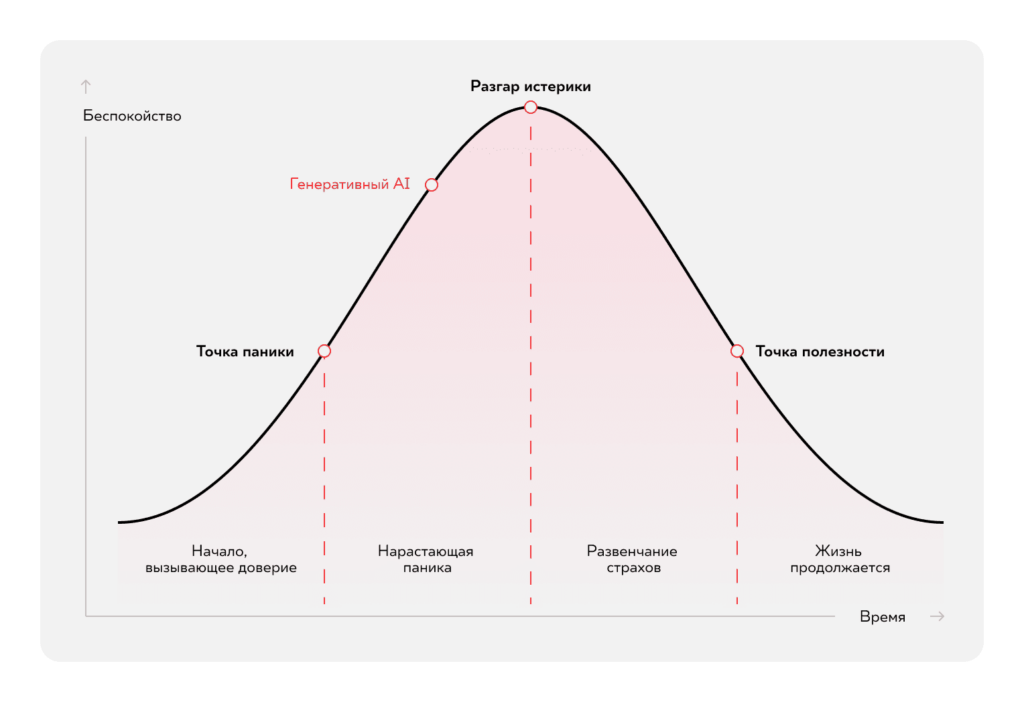

На самом деле появление любой технологии сопровождается уже предсказуемым сценарием, который называют «циклом технологической паники» (the Tech Panic Cycle): сначала страх нарастает, достигает пика, а когда общество привыкает к технологии и её преимуществам, паника постепенно сходит на нет.

Четыре стадии цикла технологической паники

Люди привыкают к новой технологии постепенно, причём, чем меньше потенциальная опасность и чем больше пользовательских кейсов, тем быстрее этот процесс. Но результат всегда один и тот же: общество принимает технологию и осознаёт, что паникёры вводили их в заблуждение и преувеличивали риски. Этот сценарий и называют «циклом технологической паники».

Стадии цикла паники из-за AI

В цикле четыре стадии:

- Начало, вызывающее доверие.

- Нарастающая паника.

- Развенчание страхов.

- Жизнь продолжается.

Стадия 1: начало, вызывающее доверие

Поначалу о новом изобретении знает ограниченный круг людей: обычно это сами создатели технологии, эксперты и гики индустрии. В этот период страхи держатся на низком уровне.

Уже на этом этапе предсказатели узнают о новом продукте и начинают поднимать тревогу. Они пока что не знают наверняка, в чём потенциальная опасность продукта, поэтому им приходится фантазировать. 🙂

Например, агентство AccessNow сообщало, что Microsoft подслушивает собрания в Teams, чтобы тренировать свою новую модель VALL-E (AI-модель для преобразования текста в речь). Это обвинение оказалось ложью: на самом деле модель VALL-E обучалась на основе публичного аудиоархива Libri-Light.

Стадия 2: нарастающая паника

На этой стадии локальные опасения превращаются в серьёзные страхи и получают широкую огласку. Политики и лидеры общественных мнений подтверждают опасения: они предлагают законопроекты, подписывают петиции и делают заявления. Журналисты не могут удержаться от искушения осветить такие новости и строчат кликбейтные заголовки.

В какой-то момент паника достигает апогея и наступает «разгар истерики».

Стадия 3: развенчивание страхов

Общество привыкает к новой технологии и принимает её преимущества. К этому моменту становится понятно, что большинство страхов никогда не сбудутся. Противники технологии могут продолжать сеять панику, но они уже не получают особой поддержки.

Стадия 4: жизнь продолжается

Конец света не наступает и страхи опровергаются (иногда теми же людьми, кто в самом начале сеял панику по этому поводу). Так, в 2000 году на портале Wired вышла статья под названием «Почему будущее не нуждается в нас», а уже в 2008 году они выпустили статью «Почему будущее всё же будет нуждаться в нас ещё некоторое время». Изобретения, которых люди ещё недавно боялись, теперь пользуются всеобщей любовью и популярностью.

С появлением новой технологии обязательно возникнет новая паника: она вытеснит старые страхи, и цикл повторится.

Что влияет на развитие паники из-за AI: четыре фактора

Каждая технологическая паника развивается под воздействием четырёх элементов. Они помогут нам увидеть закономерности развития паники по поводу нейросетей.

Элитаризм

Что в AI раздражает больше всего? Его доступность широкому кругу пользователей.

Традиционно считается, что творчеством обычно занимаются некие элиты — отдельный круг людей, которым доступны инструменты для создания чего-то нового. Этот стереотип ещё не стал атавизмом: когда появляется что-то, что делает творчество более доступным и демократичным, элитам сложно это принять.

Выступления против технологии

Любая новая технология — это возможность поговорить о рисках и развить очередную фобию.

Противники технологии с удовольствием вовлекаются в краудфандинг или продажу книг с названиями вроде «Кому на самом деле принадлежит будущее» или «Оружие массового поражения». В общем, для этих людей AI — способ продвинуть свою точку зрения и, конечно же, заработать на ней.

Новостные медиа

Как и противники технологий, новостные медиа обычно очень любят антиутопические сюжеты, ведь они отлично сочетаются с их главной целью — привлечь побольше внимания.

Часто даже очень серьёзные издания не могут удержаться от соблазна поддержать панику. Например, в феврале New York Times заявил, что чат-бот Bing AI — живой и способен любить. Конечно, такие заметки от крупных медиа превращают панику в настоящую истерику.

Законодательство

Инфлюенсеры и политики обычно хотят поскорее прокомментировать ситуацию и взять её под контроль. На этом этапе спешить как раз не стоит: технология развивается и ранние необдуманные решения обычно переосмысливаются и кардинально меняются.

Я активно пользуюсь всеми возможными AI-инструментами, а также смотрю, что делают другие люди. Думаю, я отношусь к лагерю людей, чётко понимающих, что нет предпосылок к увольнению сотрудников, но есть дополнительные инструменты, которые делают жизнь проще!

Мне кажется, со временем могут появиться профессиональные роли, когда нужно будет грамотно составлять запросы или что-то настраивать с помощью ИИ для получения желаемого результата в короткий срок. И нейросети здесь будут выступать инструментом, а не ведущим лицом.

Инна Чикина

web-designer студии Process

Как развивается паника из-за генеративного AI

Всё началось в 2014 году, когда Ян Гудфеллоу (на тот момент сотрудник Google) описал понятие генеративно-состязательной сети (GAN) — инструмента для генерации изображений. Паника получила своё развитие в 2017, когда AI-модели научились создавать дипфейки: тогда все обсуждали проблему распространения дезинформации через фейковые видео с мировыми лидерами.

Однако страхи сохранялись на низком уровне и многие смотрели на будущее AI с оптимизмом; большинство медиа бодро писали о возможностях использования искусственного интеллекта в музыке, дизайне, маркетинге, обучении сотрудников и рутинных задачах.

Сомнения и серьёзные споры вокруг AI возникли как следствие его необыкновенной популярности: так ChatGPT достиг отметки в 100 миллионов пользователей за два месяца, что сделало его самым популярным потребительским продуктом в истории.

Способность генеративного AI производить практически безлимитное количество контента просто свело паникёров с ума. Заголовки новостных медиа достигли какого-то нового уровня сенсационности:

Читайте также

- The New York Times: «Как ChatGPT похитил демократию»

- Time: «Новая нейросеть Bing угрожает пользователям. И это не шутка»

- Daily Star: «Атака сумасшедшего чат-бота»

Тем временем усиливается страх массовой безработицы, и медиа сгущают краски ещё сильнее. Например, в марте вышла статья под названием «Согласно исследованию OpenAI, GPT повлияет на карьеру 80% американских сотрудников». Однако это исследование говорит иное: на самом деле GPT повлияет на 10% рабочих задач 80% сотрудников. Но кликбейтный заголовок делает своё дело: набирает просмотры и, конечно же, сеет панику.

В конце марта 25 тысяч человек (в том числе Илон Маск и Стив Возняк) подписали открытое письмо с призывом остановить развитие AI.

А уже в апреле мы узнаём, что Илон Маск успел основать собственную компанию в сфере AI. Получается, это открытое письмо было всего лишь попыткой замедлить конкурентов?

Думаю, в ближайшее время нейросети меня не заменят. У нас, менеджеров, своя специфика работы, например, настройка сложных сценариев и разруливание ситуаций с клиентами. Нейросеть работает утилитарно, без эмпатии и достаточной гибкости. Конечно, сейчас уже есть AI-инструменты, которые могут анализировать базы данных, отвечать на вопросы и даже определять настроение собеседника по ключевым словам, но трудно представить, как ИИ сможет считывать полутона или эмоции.

Для меня как менеджера полезной была бы нейросеть для планирования времени, которая раскидывала бы задачи по дням и даже по времени дня, анализировала мою продуктивность и понимала приоритетность задач.

Никита Швецов

CRM-маркетолог CRM-group

Чему нас учит паника из-за AI: три важных урока

Итак, мы выяснили, что подобная паника — это не новое явление, а очередной цикл технологической паники.

Когда кажется, что весь мир сходит с ума по поводу искусственного интеллекта, нам всем важно включить критическое мышление и усвоить три важных урока.

Урок 1: рост популярности AI — это не конец света

Паника возникает по причине страха неопределённости и чувства, что катастрофа неизбежна. Однако это не совсем так.

Нет, мы не утверждаем, что все опасения бессмысленны. Просчитать риски — это вполне разумно и это доказывает опыт предыдущих технологических споров, когда люди задавали вполне логичные вопросы, а лидеры просчитывали пути решения проблем. Хотя многие страхи так и не исполнились, это не значит, что рисков не было вообще.

Только важно помнить, что осторожность и паника — это разные вещи. Если осторожность помогает нам просчитать разные варианты и перестраховаться, то паника отвлекает нас и смещает наш фокус с реальных проблем на гипотетические или преувеличенные.

Я не беспокоюсь, что меня заменит ИИ, по крайней мере, ближайшие лет пять.

Нейросети не работают, например, с электронными письмами: они не знают, что можно считать хорошей адаптацией, не могут оценить правильность вёрстки, не сверстают письмо и не протестируют, то есть, готовых решений для email-маркетинга у ИИ на текущий день нет.

На сегодняшний день ИИ может описать стратегию, но не настроить её. В CDP/ESP-платформах специфичный инструментарий для настройки сложных триггерных сценариев, которые пока не под силу нейросетям.

Александр Волков

CRM-маркетолог CRM-group

Урок 2: времена не изменились

Противники генеративного AI делают акцент на уникальности этой технологии: мол, ничего подобного никогда раньше не было, да и времена другие. Однако суть утверждений об опасности AI нельзя назвать новой — критики часто забывают о прошлом опыте.

Тристан Харрис, один из противников AI, как-то сравнил алгоритмы соцсетей с изобретением велосипеда: «Ведь когда появились велосипеды, никто не расстроился. Никто не говорил, что велосипеды разрушают общество, что велосипеды влияют на людей…».

Но Харрис ошибся. На самом деле люди как раз говорили подобное о велосипедах: в 19-м и начале 20-го века газеты обвиняли велосипеды в том, что они сводят людей с ума, вызывают различные болезни и увеличивают шансы преждевременной смерти.

Скорее всего нас ждёт не замена людей на нейросети, а замена людей, которые не используют AI в работе, на тех, кто прибегает к их помощи. Например, один автор пишет 10 текстов в месяц, а другой 100 текстов такого же качества. Очевидно, чья работа эффективнее. Если задача не требует больших квалификаций, конечно, её логично автоматизировать с помощью нейросети и направить ресурс на более сложные задачи, требующие менее унифицированного подхода.

Никита Швецов

CRM-маркетолог CRM-group

Урок 3: не стоит принимать опасения близко к сердцу

Этот урок особенно касается тех, кто принимает решения и регулирует политику в отношении AI. Пока цикл паники не закончится, лидеры должны поставить на паузу любые кардинальные изменения.

Целью новых законов должна быть реальная, а не выдуманная угроза. А ещё, необходимо защитить преимущества технологии и сделать так, чтобы искусственный интеллект продолжил служить обществу.

Некоторые страны уже действуют осторожно: например, Великобритания признала, что создавать новые законы в отношении AI пока преждевременно.

Интересно, что ЕС предложил более серьёзное решение — рассматривать генеративный AI как технологию с высоким риском. В Китае похожая история: правительство предложило ввести специальные правила для регулирования генеративного AI. Некоторые американские политики также предлагают срочно ввести новые законы в отношении новой технологии.

Однако новые законы с большой долей вероятности могут оказаться ошибочными, ведь их разрабатывают очень поспешно, на фоне всеобщей паники.

AI никогда не заменит в диджитале того, кто будет уметь:

- производить оригинальный контент, а не собранный из образов, на которых его научили;

- добавлять эмоциональную привязку;

- строить UX-интерфейс на основе психологического анализа поведения пользователя, да и вообще сможет в психоэстетику.

Инна Чикина

web-designer студии Process

Вывод

Генеративный AI обладает огромной силой и потенциалом изменить многие сферы нашей жизни: маркетинг, образование, развлечения и другие. Этот потенциал и вызывает страх, что приводит нас к уже знакомому «циклу технологической паники».

Сама по себе технология ни хорошая, ни плохая. AI — это всего лишь код и данные без каких-либо эмоций или сознания. Технология новая, но не страшная и не всесильная.

Чтобы сделать объективный вывод о рисках и влиянии AI, потребуется какое-то время. А пока длится очередной цикл паники, лучше всего наблюдать и сохранять спокойствие.

Перевела статью

Анна Сенькина

писатель контент-агентства Monk

Часто задаваемые вопросы

Паника из‑за AI: как сохранять?

Четыре стадии цикла технологической паники?

Что влияет на развитие паники из-за AI: четыре фактора?

Как развивается паника из-за генеративного AI?

Чему нас учит паника из-за AI: три важных урока?

Подписывайтесь на обновления

Узнавайте об обновлениях в блоге первым

Отправляем только свежие статьи и кейсы

Некоторые функции нейросеть уже может выполнять полностью или сильно ускорять, если используется как ассистент. Список этих функций будет постоянно расти. Но помним, что всегда и во всех областях будет что-то, где ИИ или неприменим, или справляется плохо, или справляется нормально, но человек делает это правильнее, лучше, быстрее.

Иван Дудин

руководитель IT-проектов CRM-group